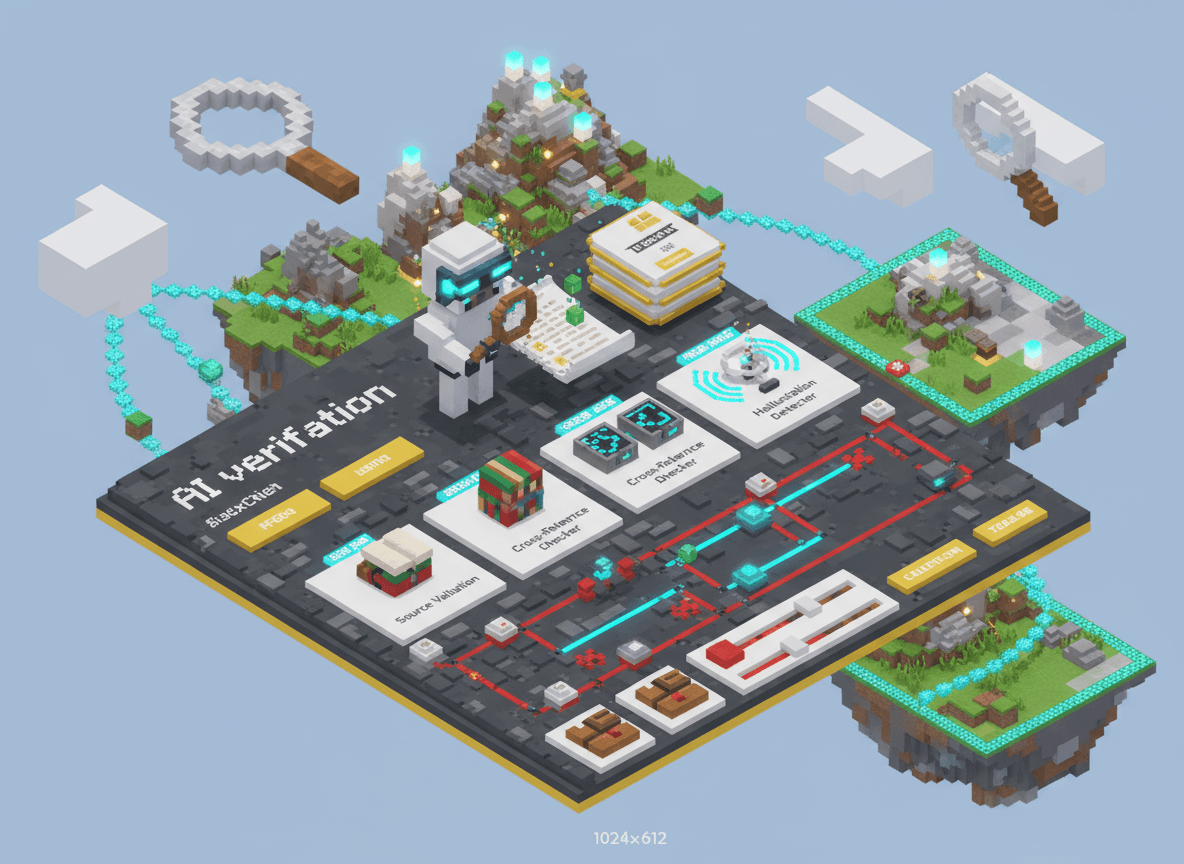

Точность фактов в ИИ: как проверять ответы нейросетей

Нейросети ошибаются? Гайд по проверке фактов, верификации ответов и борьбе с галлюцинациями ИИ. Подберите надёжный инструмент в агрегаторе!

Нейросеть выдала убедительный ответ с цифрами и ссылками, но информация оказалась выдуманной. Галлюцинации ИИ — реальная проблема, которая может стоить репутации или денег.

В 2026 году генеративный ИИ стал мощнее, но не идеальнее. Понимание того, как проверять ответы нейросетей, защищает от ошибок. Разберём практические методы верификации фактов и надёжные инструменты.

Почему ИИ ошибается: природа «галлюцинаций»

Большие языковые модели не ищут информацию в базе данных. Они предсказывают наиболее вероятное продолжение текста на основе паттернов обучения.

Основные причины неточностей:

- Статистическая природа — модель генерирует правдоподобный текст, а не проверяет истинность

- Устаревшие данные — знания модели ограничены датой последнего обучения

- Неоднозначные промпты — размытые запросы повышают риск домыслов

- Конфликт источников — противоречивая информация в обучающей выборке сбивает модель с толку

- Сложные запросы — многошаговые задачи увеличивают вероятность ошибки на каждом этапе

Достоверность контента от ИИ зависит не только от модели, но и от качества вашего запроса.

Важно: даже флагманские модели 2026 года не гарантируют 100% точности фактов. Проверка остаётся обязанностью пользователя.

Методы проверки: от простой перекрёстной сверки до RAG

Не все способы верификации одинаково эффективны. Выбор зависит от критичности информации.

Практические подходы к фактчекингу:

- Перекрёстная проверка — сравнение ответа ИИ с авторитетными источниками (официальные сайты, реестры, научные базы)

- Запрос источников — попросите модель указать, откуда взята информация, и проверьте ссылки

- Использование RAG-систем — технологии поиска по актуальной базе знаний снижают риск выдумок

- Дублирование в другой модели — запуск того же промпта в альтернативной нейросети для сравнения результатов

- Экспертная валидация — привлечение специалиста для проверки критически важных данных

Инструменты для верификации экономят время: некоторые сервисы автоматически подсвечивают сомнительные утверждения.

Для повседневных задач достаточно перекрёстной проверки. Для юридических, медицинских или финансовых решений — обязательна экспертная оценка.

На что обратить внимание при работе с ИИ

Проактивные меры снижают риск ошибок до того, как они произойдут.

Критические параметры для контроля:

- Прозрачность модели — указывает ли сервис, когда информация может быть неточной

- Доступ к свежим данным — подключена ли модель к интернету или работает только на знаниях до даты обучения

- Функция цитирования — возможность получать ответы с прямыми ссылками на источники

- Настройка строгости — некоторые модели позволяют повысить точность ценой скорости

- Логика рассуждений — включение режима «chain of thought» помогает отследить ход мысли модели

Проверка фактов начинается с грамотного промпта. Чёткий запрос с указанием требований к источникам улучшает результат.

Избегайте вопросов, требующих однозначного ответа на спорные или быстро меняющиеся темы.

Практический гид: как организовать надёжный воркфлоу

Шаг 1. Оценка критичности. Определите: ошибка в этом ответе стоит времени, денег или репутации?

Шаг 2. Выбор стратегии. Для низких рисков — быстрая перекрёстная проверка. Для высоких — многоуровневая верификация с экспертом.

Шаг 3. Оптимизация промпта. Добавьте инструкции: «Укажи источники», «Если не уверен — скажи об этом», «Проверяй даты и цифры».

Шаг 4. Использование инструментов. Подключите плагины для поиска в реальном времени или RAG-системы для работы с вашей базой знаний.

Шаг 5. Документирование. Для важных решений фиксируйте: запрос, ответ модели, проверенные источники, итоговое решение.

Популярные решения для фактчекинга:

- Модели с встроенным поиском по интернету

- Сервисы с автоматической проверкой утверждений

- Платформы для командной верификации с историей изменений

Стоимость варьируется: базовые функции часто бесплатны, продвинутые инструменты — от 500 ₽/мес.

Тренды верификации в ИИ в 2026 году

Рынок реагирует на проблему доверия к контенту.

Ключевые направления:

- Встроенный фактчекинг — модели самостоятельно помечают утверждения, требующие проверки

- Динамическое обновление знаний — непрерывное дообучение на актуальных данных без полного перезапуска

- Аудит ответов — инструменты для отслеживания происхождения каждого факта в ответе

- Стандарты достоверности — отраслевые требования к точности ИИ в медицине, финансах, юриспруденции

Генеративный ИИ становится более прозрачным: пользователи получают не только ответ, но и оценку его надёжности.

Итоги: доверяй, но проверяй

- Точность фактов в ИИ не гарантирована: даже лучшие модели допускают ошибки в 5–15% случаев

- Многоуровневая верификация ответов снижает риски без значительного увеличения времени работы

- Грамотный промпт и выбор подходящего инструмента — половина успеха в борьбе с галлюцинациями ИИ

Не ищите надёжные инструменты для фактчекинга вручную. Воспользуйтесь нашим агрегатором ИИ-решений: фильтруйте нейросети по функциям верификации, доступу к источникам и тарифам. Найдите сервис, который поможет работать с информацией безопасно и эффективно.