Как работает контекстное окно ИИ: память и ограничения

Почему нейросеть забывает начало диалога? Всё о контекстном окне, токенах и работе с длинными текстами. Сравните модели в агрегаторе!

Вы ведёте длинный диалог с чат-ботом, и вдруг он перестаёт учитывать ваши первые инструкции. Или загружаете большую книгу, а нейросеть не может найти информацию в начале файла.

В 2026 году модели стали умнее, но ограничения памяти сохраняются. Понимание того, как работает контекстное окно, поможет правильно выбирать ИИ-инструменты и избегать ошибок. Разберём техническую сторону вопроса простым языком.

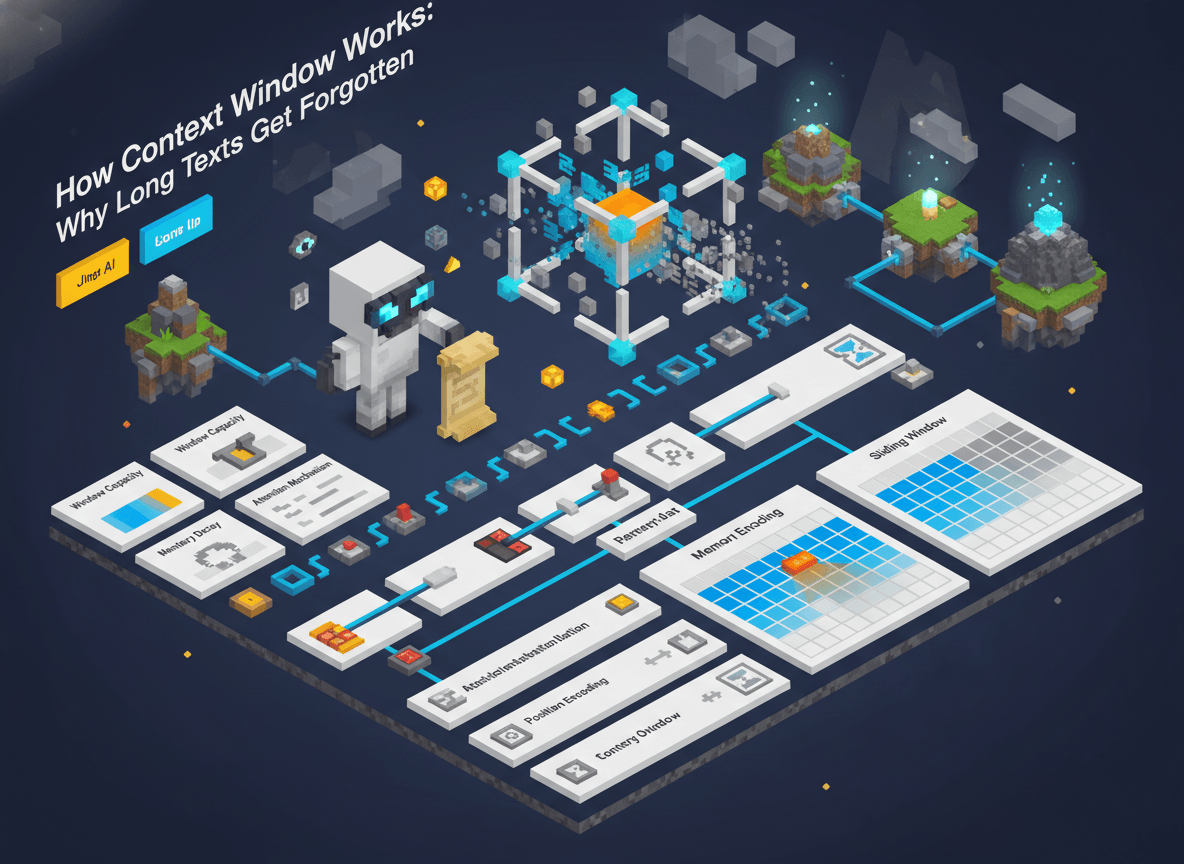

Что такое контекстное окно простыми словами

Контекстное окно — это объем информации, который модель может удерживать в «памяти» одновременно. Это аналог кратковременной памяти человека.

Из чего складывается объем:

- Входные токены — ваш запрос, загруженные файлы, история переписки

- Выходные токены — ответ, который генерирует генеративный ИИ

- Системные инструкции — скрытые настройки, задающие поведение модели

Всё измеряется в токенах. Один токен — это примерно 3–4 символа или часть слова. Текст на 1000 слов занимает около 1300 токенов.

Когда сумма входных и выходных данных превышает лимит, модель вынуждена «забыть» часть информации. Обычно удаляется самый старый текст из начала диалога.

Почему нейросеть «забывает» начало диалога

Проблема не в ошибке программы, а в архитектуре. У каждой памяти модели есть физический предел, обусловленный вычислительными ресурсами.

Механика потери данных:

- Достижение лимита — когда окно заполнено, новые токены не помещаются

- Вытеснение старого — система обрезает начало диалога (принцип FIFO)

- Снижение внимания — даже в пределах лимита модель может хуже фокусироваться на удалённых частях текста

- Стоимость обработки — работа с большим контекстом требует больше энергии и времени

Это влияет на качество ответов. Нейросеть может противоречить своим же словам, сказанным десять сообщений назад.

Важно: некоторые модели используют специальные алгоритмы сжатия, чтобы уместить больше смысла в меньшее количество токенов.

На что обратить внимание при выборе модели

Если вы работаете с большими документами или длинными переписками, размер окна критичен.

Ключевые критерии выбора:

- Размер окна — от 8K до 1M+ токенов в современных версиях 2026 года

- Стоимость токенов — большое окно часто стоит дороже за каждый запрос

- Точность поиска (Needle In A Haystack) — способность находить факты в середине большого текста

- Скорость обработки — большие объемы данных генерируются медленнее

- Поддержка файлов — возможность загружать PDF, TXT, код напрямую

Сравнивайте тарифы разных провайдеров. Иногда выгоднее взять модель с меньшим окном, но использовать технику суммаризации.

Генеративный ИИ с большим контекстом не всегда лучше. Для коротких задач это лишняя трата бюджета.

Практический гид: как работать с длинными текстами

Даже если у модели маленькое окно, есть способы обойти ограничение.

Шаг 1. Разбиение на части (Chunking). Делите большой документ на логические главы. Загружайте и обрабатывайте их по очереди.

Шаг 2. Саммари диалога. Периодически просите модель кратко пересказать суть предыдущей переписки. Используйте эту выжимку как новый контекст.

Шаг 3. Использование RAG. Технология поиска по базе знаний. Модель ищет только релевантные куски текста, а не читает всё подряд.

Шаг 4. Оптимизация промптов. Убирайте лишние инструкции из начала диалога. Оставляйте только ключевые правила.

Шаг 5. Выбор специализированных инструментов. Для анализа книг используйте сервисы с окном от 100K токенов. Для чата хватит 8–32K.

Популярные решения:

- Модели с расширенным контекстом для анализа документов

- Сервисы с встроенной функцией долгосрочной памяти

- Локальные решения для работы с конфиденциальными данными

Стоимость использования зависит от объема: большие окна могут увеличивать чек в 5–10 раз.

Тренды работы с памятью ИИ в 2026 году

Рынок движется к решению проблемы ограничений. Технологии становятся эффективнее.

Ключевые направления:

- Бесконечный контекст — архитектуры, позволяющие теоретически неограниченную память

- Умное сжатие — автоматическое удаление «воды» из диалога без потери смысла

- Внешняя память — подключение векторных баз данных для хранения истории

- Оптимизация затрат — снижение цены токена для больших объемов данных

ИИ-инструменты учатся управлять вниманием лучше человека, выделяя главное в потоке информации.

Следите за обновлениями: новые версии моделей часто увеличивают лимиты без повышения цены.

Итоги: управление памятью нейросети

- Контекстное окно ограничивает объем информации, который нейросеть обрабатывает за один раз

- При превышении лимита модель забывает начало диалога, что влияет на согласованность ответов

- Правильная стратегия работы (разбиение, саммари, RAG) позволяет обходить технические ограничения

Не гадайте, какая модель подойдет для ваших задач. Воспользуйтесь нашим агрегатором ИИ-инструментов: фильтруйте нейросети по размеру контекстного окна, стоимости токенов и возможностям работы с файлами. Найдите оптимальное решение для работы с длинными текстами уже сегодня.